Yuval Harari tem razão sobre IA

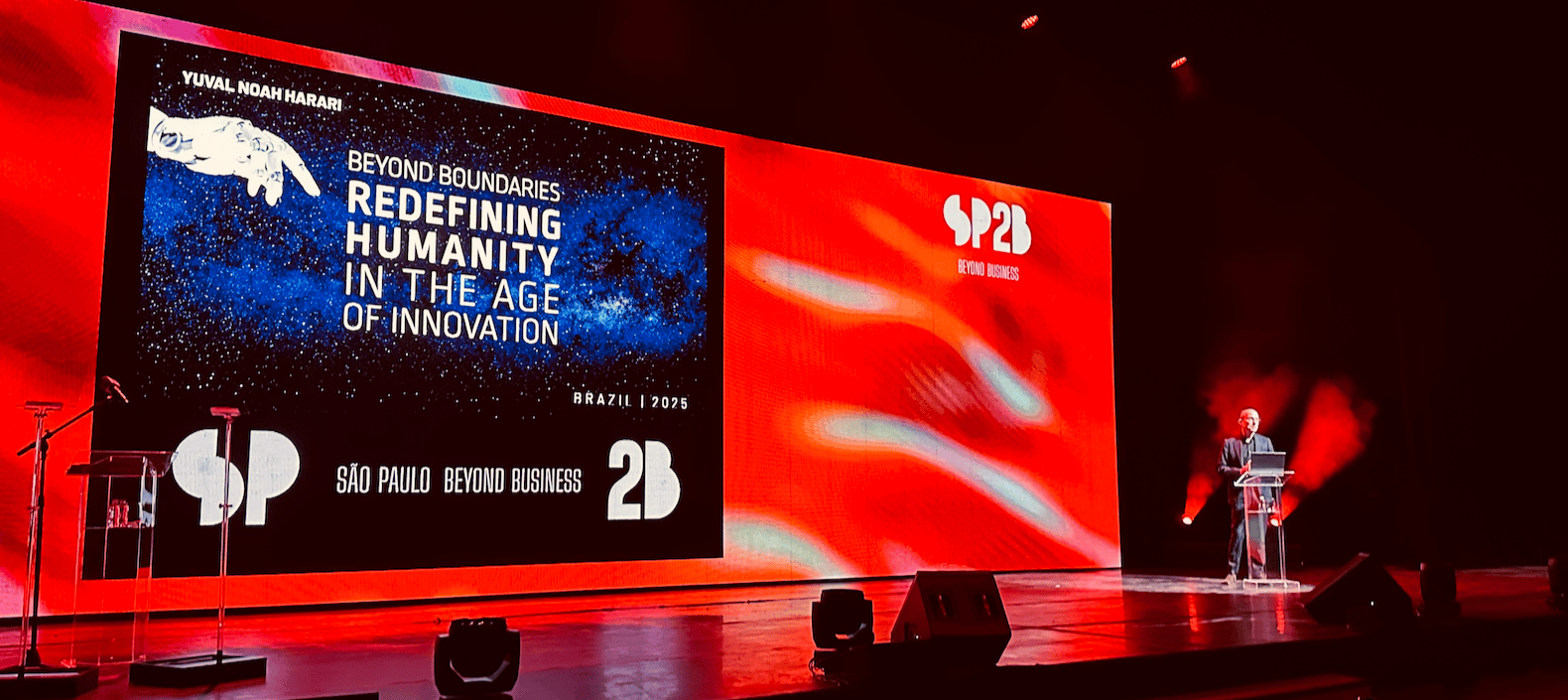

No domingo, 17 de agosto de 2025, eu vi uma palestra do historiador Yuval Harari no Parque do Ibirapuera, e foi excelente.

Em cerca de 40 minutos, Harari fez um excelente diagnóstico dos muros políticos sendo erguidos agora em vários países do mundo, e pintou cenários dos caminhos do mundo com uma potencial ascensão da inteligência artificial como tomadora de decisões – não apenas como ferramenta, como é hoje.

Um dos pontos principais da palestra tratou que, até hoje, independentemente de qualquer avanço tecnológico, foi o ser humano que tomou decisões e levou a humanidade pra frente (pro bem ou pro mal). Mas os avanços de inteligência artificial, se plenamente concretizados (ou seja, superinteligência), vão criar uma nova forma de tomada de decisões, que é imprevisível e difícil de confiar.

Harari define IA como uma inteligência capaz de aprender sozinha e tomar decisões sozinha – e ele define assim porque essa é a definição que deveria ser de fato. Tal definição, no entanto, conflita com as taxonomias aplicadas aos modelos de linguagem atuais, que basicamente abastecem ferramentas de produtividade que operam sob comando das pessoas, não autonomamente.

Ou seja, o ChatGPT não pensa por ele mesmo, ele não faz nada sem comandos (ainda), e ele só "aprende" de verdade com dados produzidos no mundo real (há questionamentos sobre a eficiência do uso de dados sintéticos para treinar IAs). A partir do momento que ele conseguir aprender sozinho e pensar sozinho, aí sim ele vai conseguir tomar decisões.

Apesar de haver muitos sistemas com IA embutida, tomando decisões sobre quais posts impulsionar e a taxa de juro que cobrar de um empréstimo, esses sistemas são delimitados por humanos, não pela própria inteligência artificial. Aí que mora a diferença.

Se nos próximos anos a promessa de superinteligência se concretizar, como prevêem líderes dessa indústria como Sam Altman (OpenAI) e Dario Amodei (Anthropic), entre outros, sistemas de IA podem ser responsáveis por muito mais do que comprar passagens aéreas e reservar mesas em restaurantes.

Um exemplo interessante que ele usou foi de instrumentos de investimentos, com os CDOs (um dos maiores responsáveis pela crise econômica de 2008). Se esses instrumentos, criados por matemáticos e financistas, era tão complexo a ponto de ludibriar quase todo mundo, que acontecerá se sistemas mais inteligentes que nós começarem a criar produtos financeiros.

A sugestão de Harari foi que, antes de desenvolver esses sistemas, os humanos precisam melhorar a comunicação entre si –– algo do qual a humanidade tem afastado nos últimos anos, após uma relativa calmaria no começo do século 21. Ao ter um consenso sobre como desenvolver esses sistemas de IA, Harari sugere que devermos passar uma mensagem unificada, quase maternal, sobre como esses sistemas vão tratar seres humanos. Essa parte me pareceu bem mais similar a cenários de ficção científica, mas Harari acha que esse vai ser o caso.

Seja como for, Harari toca num ponto muito importante de desenvolvimento responsável da IA, algo que não está sendo respeitado à medida que as empresas lutam por dominância comercial.

O evento que eu fui foi uma prévia do SP2B.